O advogado pede desculpas pelos erros criados em inteligência artificial no caso de assassinato australiano

Os heróis da Suprema Corte de Victoria são outra Austrália em um conjunto de acidentes causados pela inteligência artificial em sistemas de justiça em todo o mundo.

Melbourne, Vic – Um grande advogado na Austrália pediu desculpas a um juiz para enviar pedidos em A. matar A questão, que incluía citações falsas e as disposições da questão não existente criada pela inteligência artificial.

O erro na Suprema Corte em Victoria é o último em um conjunto de acidentes A inteligência artificial causou sistemas de justiça Em todo o mundo.

O advogado de defesa, Rishi Natwani, que detém o prestigiado título legal do advogado do rei, assumiu a “total responsabilidade” de fornecer informações incorretas em solicitações em um caso adolescente acusado de morte, de acordo com os documentos do tribunal que a Associated Press testemunhou na sexta -feira.

“Lamentamos muito e envergonhar o que aconteceu”, disse Natwani a James Elliot na quarta -feira, em nome da equipe de defesa.

o Erros de inteligência artificial Ele causou um atraso de 24 horas na solução do caso que Elliot esperava concluir na quarta -feira. Elliot gastou na quinta -feira que o agente de Natwani, que não pôde ser reconhecido porque era menor de idade, não era culpado de morte devido à fraqueza mental.

“Correndo o risco de testar, a maneira como esses eventos foram revelados não é satisfatória”, disse Elliot a advogados na quinta -feira.

Elliot acrescentou: “A capacidade do tribunal de confiar na precisão da submissão feita pelo advogado é essencial para o governo devido à justiça”.

As operações falsas de envio incluíram citações fabricadas de uma carta ao órgão legislativo estadual e as instruções de casos que não estão presentes no Supremo Tribunal.

Os erros foram descobertos pelos parceiros de Elliot, que não conseguiram encontrar os casos e pediram aos advogados de defesa que enviassem cópias.

Os advogados admitiram que o martírio “não está presente” e que o aplicativo contém “citações falsas”, de acordo com documentos do tribunal.

Os advogados explicaram que estavam verificando que as categorias iniciais eram precisas e a suposição de que outros também estariam corretos.

Os pedidos também foram enviados ao promotor Daniel Bordodo, que não foi preciso.

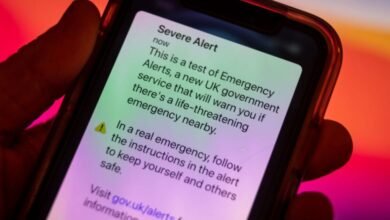

O juiz indicou que a Suprema Corte emitiu uma orientação no ano passado para usar advogados de inteligência artificial.

Elliot disse: “Não é aceitável usar inteligência artificial, a menos que o resultado desse uso seja verificado de forma independente e abrangente”.

Os documentos judiciais não especificam o sistema obstétrico de inteligência artificial usado por advogados.

Em um caso semelhante nos Estados Unidos em 2023, um juiz federal Impondo multas de US $ 5.000 Advogados e escritório de advocacia depois de Chatgpt Eles foram culpados pela falsa pesquisa legal na demanda por voar.

O juiz disse que B. Kevin Castel, eles agiram de má fé. Mas ele fortaleceu suas desculpas e medidas terapêuticas que foram tomadas ao explicar o motivo da falta de penalidades mais graves para garantir que elas não sejam permitidas ou outras novamente com as ferramentas de inteligência artificial que exigem que eles produzam uma história jurídica falsa em seus argumentos.

Mais tarde naquele ano, mais decisões judiciais falsas inventadas pela Anistia Internacional foram mencionadas em documentos legais apresentados por Michael Cohen Advogados, ex -advogado pessoal do presidente dos EUA, Donald Trump. Cohen culpou, dizendo que não percebeu que a ferramenta do Google que ele estava usando para pesquisas legais também era capaz de alucinações de inteligência artificial de maneira tão chamada.

Juiz da Suprema Corte Britânica Victoria Sharp Foi avisado em junho que fornecer materiais errados como se fossem reais pode ser considerado desprezo pelo tribunal ou nos “casos mais terríveis”, que exibem o curso da justiça, que leva um período de prisão perpétua na prisão.

Copyright 2025 Associated Press. Todos os direitos reservados. Esses materiais não podem ser publicados, transmitidos, escritos ou redistribuídos.