Características Notícias

O prefeito de Istambul e a oposição de Erdogan prendidos

IE 11 não é suportado. Para uma experiência ideal, visite nosso site em outro navegador.

A equipe da ONU morto e feriu em greve na Gaza Guesthouse

01:06

Juiz Regras Doge esforços para fechar a USAID provavelmente inconstitucional

05:23

Os parlamentares húngaros se refletem como o parlamento proíbe os eventos do Orgulho

00:47

Agora jogando

O prefeito de Istambul e a oposição de Erdogan promete ‘ficar alto’ após a prisão

01:16

A seguir

O que é ‘Tren de Aragua’? Explicando a gangue no centro da repressão da imigração de Trump

04:40

Membros da família de migrantes deportados para El Salvador mega prisão

02:56

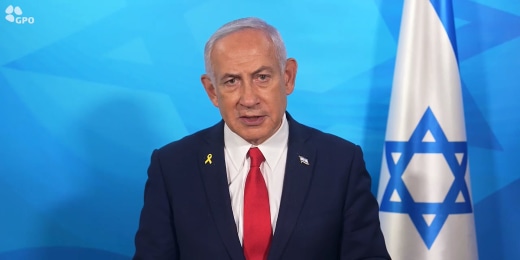

Netanyahu culpa o Hamas por mortes civis em ataques aéreos israelenses

01:05

‘Não houve aviso’: famílias em Gaza lamentam entes queridos mortos em ataques aéreos israelenses

00:59

Mensagem de parentes reféns ao governo israelense: ‘Devemos voltar a um cessar -fogo’

01:17

‘Uma situação catastrófica’: os palestinos em Gaza descrevem ataques aéreos mortais no acampamento

00:56

Trump e Putin se preparam para o telefone

06:58

Israel lança onda de ataques mortais em Gaza potencialmente terminando o cessar -fogo

05:15

Centenas mortas em Gaza enquanto Israel retoma ataques aéreos

00:45

A milícia houthis retalia, sem sucesso

02:51

Membro de uma equipe de 10 pessoas na Antártica acusada de violência física e sexual

02:23

‘Riverdance’ comemora 30 anos com estrelas de irmãos

03:25

O professor de direito fala sobre a legalidade de deportações sob Trump invocando a Lei de Inimigos Alienados

03:36

Satélite de fogo lança em órbita para ajudar a detecção precoce de incêndios florestais

03:56

A história do dia de São Patrício e o verdadeiro São Patrício

02:55

Mais de 100.000 manifestantes sérvios se reúnem em enorme comício antigovernamental

01:01

A equipe da ONU morto e feriu em greve na Gaza Guesthouse

01:06

Juiz Regras Doge esforços para fechar a USAID provavelmente inconstitucional

05:23

Os parlamentares húngaros se refletem como o parlamento proíbe os eventos do Orgulho

00:47

Agora jogando

O prefeito de Istambul e a oposição de Erdogan promete ‘ficar alto’ após a prisão

01:16

A seguir

O que é ‘Tren de Aragua’? Explicando a gangue no centro da repressão da imigração de Trump

04:40

Membros da família de migrantes deportados para El Salvador mega prisão

02:56